|

طراحی وب سایت طراحی وب سایت - طراحی سایت

| ||

|

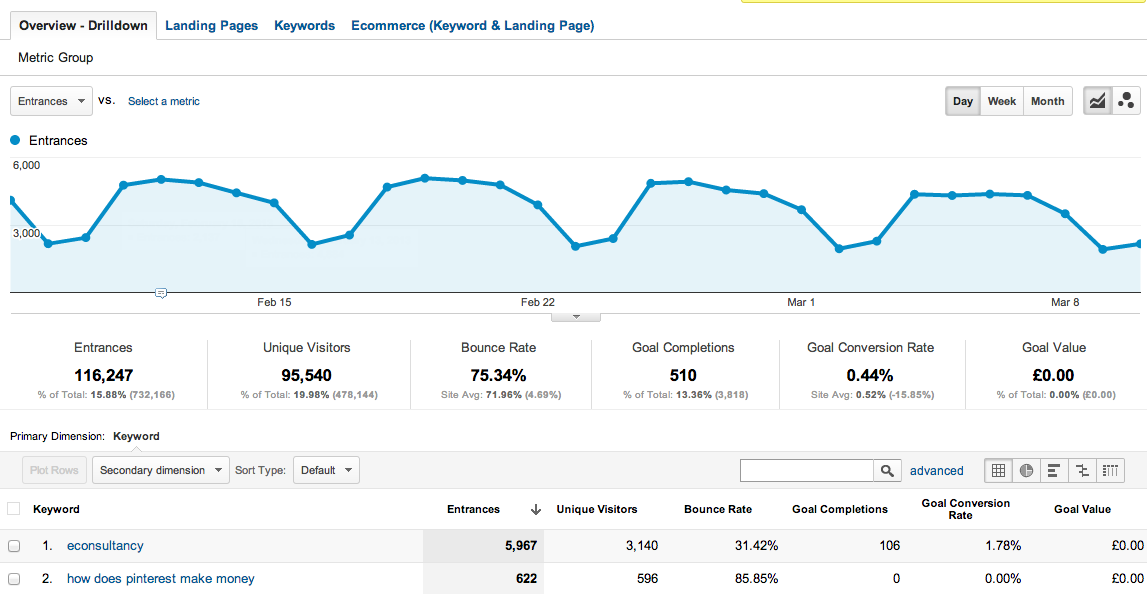

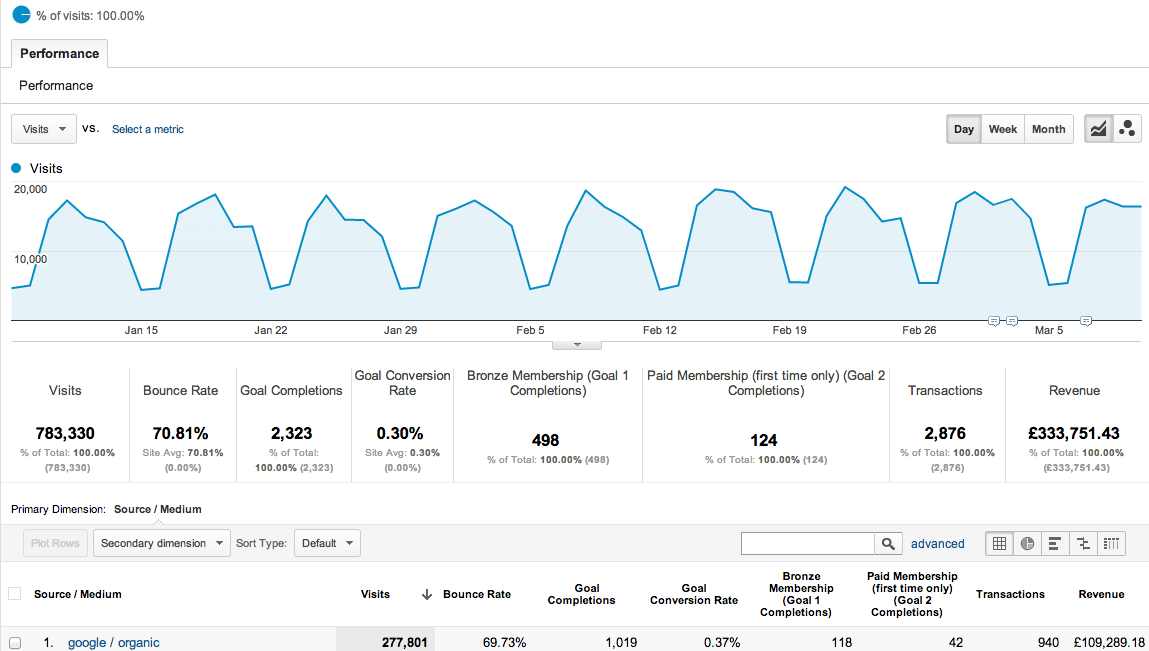

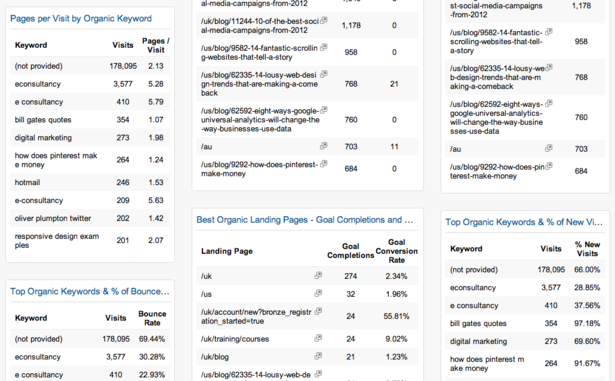

از ویژگی های بسیار کاربردی قابل تنظیم در گوگل آنالیتیکس می توان به دسترسی به ریز محتوا و اطلاعات دسترسی پیدا کرد. گزارشات سفارشی اگرچه که چنین بخشی در گوگل آنالیتیکس وجود ندارد اما کمک رسان خواهد بود. ساخت گزارشات سفارشی، یکی از راحتترین کارهاست. این گزارشات می توانند بسیار با ارزش باشند. ما یک راهنمای سریع برای چگونگی ساخت یک گزارش سریع برای شما داریم. اما اگر بخواهید خودتان هم می توانید فایل های آمادۀ موجود در اینترنت را نصب کرده و طبق اصول کاری خودتان ویرایش کنید. (اگرچه که چنین چیزی پیشنهاد نمی شود) با ما تماس بگیرید! گزارش سئو این یکی را جیمز گورد تهیه کرده و بسیار موثر برای سئو شدن از طریق کلمات کلیدی، صفحات آگهی و معیارهای تجارت الکترونیک است.

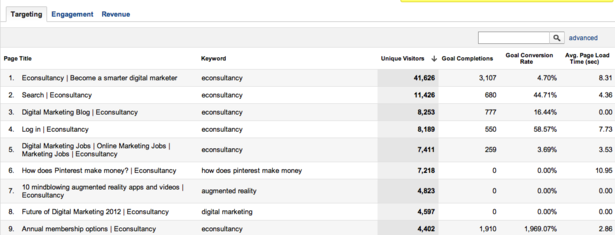

تحلیل واژگان کلیدی این نوع گزارش محبوب ترین واژگان کلیدی را نمایش می دهد و به دنبال همان ها می رود (البته به غیر از آنانی که گوگل اطلاعاتی درمورد آنها نمی دهد). همچنین متریکهای متفاوتی نظیر اعتبارات تبدیلی، اهداف تکمیل شده و زمان بارگیری که صفحه را نشان می دهد. برگه های دیگر نیز متریکهایی چون عملکرد کلی سایت و اهداف آن را نشان میدهند.

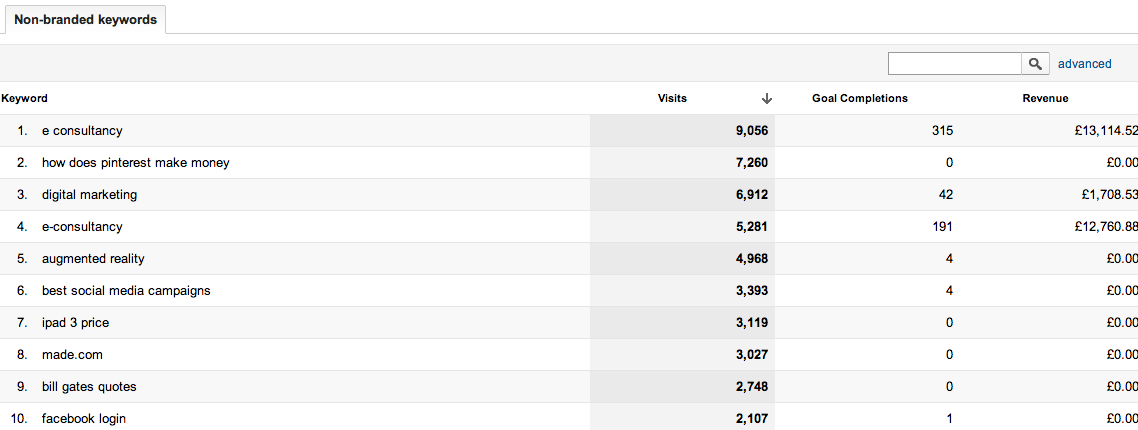

گزارش کلمات کلیدی ناشناخته این گزارش کلمات کلیدی شناخته شده را دسته بندی و فیلترمی کند و به نمایش در می آورد. هدف نهایی این کار دریافت بازدید بیشتر از راه ایجاد ترافیک هدفمند و سالم است. و هدف اصلی برآورد میزان درآمد از یک محصول، میزان بازدید و تعداد موجودی محصول است.

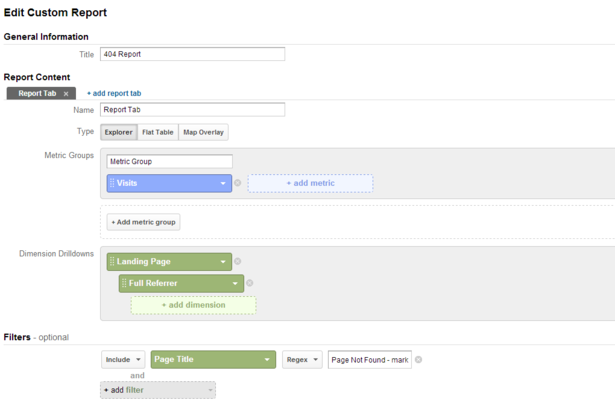

گزارش صفحات 404 این بخش توسط پیتر مینیرتزهاگن ایجاد شده که شما باید خودتان آن را تکمیل کنید اما این می تواند بسیار موثر در شناسایی و رفع مشکلات مربوط به خطاهای 404 باشد. در اسکرین شات زیر نحوۀ تنظیمات این گزارش آورده شده است. ببینید چطور می توان یک خطا را عیب یابی کرد.

گزارش تفکیک هدف در سئو یک پکیج آماده از تمام معیارهای سئو. این گزارش را دانلود کنید.

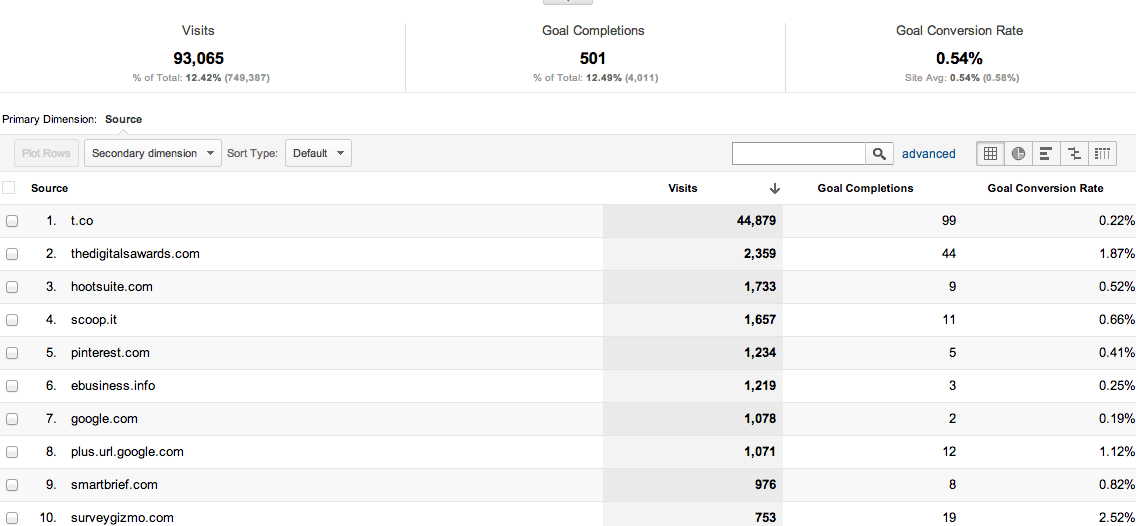

گزارش سایتهای رجوع شده این گزارش توسط آنا لوییس درج و منتشر شده؛ و به مدیر یک سایت تمام اهداف و اعتبارات گفتمانی را جهت کمک به یافتن ارزش لینک هایی که دریافت کرده (به نوعی بک لینک) مشخص می نماید. این گزارش را دانلود کنید.

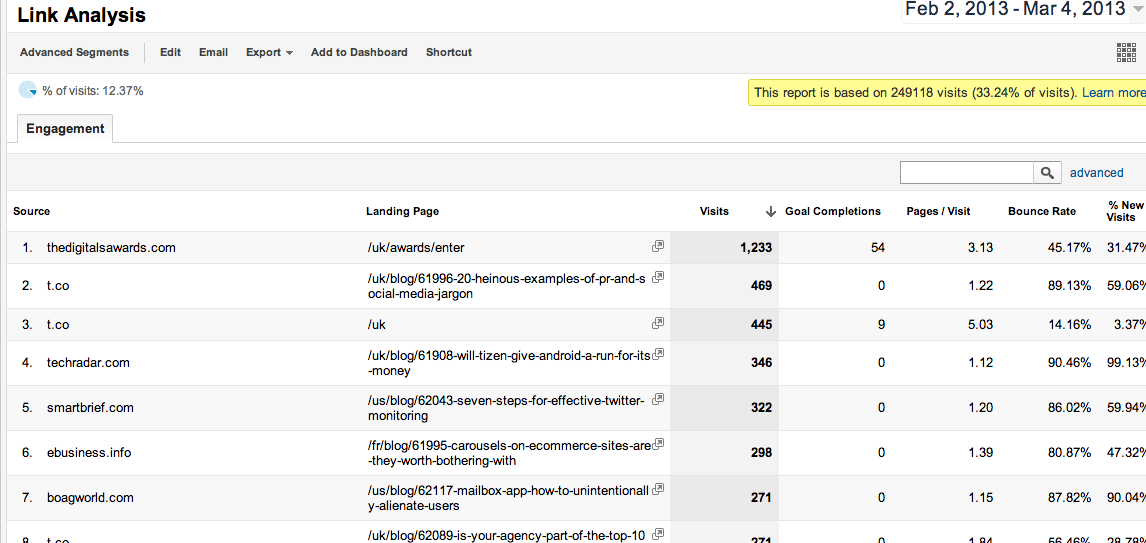

گزارش تحلیل لینک ها این گزارش توسط سئوبوک تهیه شده و شما را قادر می سازد تا لینک هایی که بیشترین ترافیک را به سوی سایت شما می فرستند شناسایی کنید، تعداد بازدیدها را بیابید و بعدتر را پیش بینی کنید. گزارش تحلیل لینک ها را دانلود کنید.

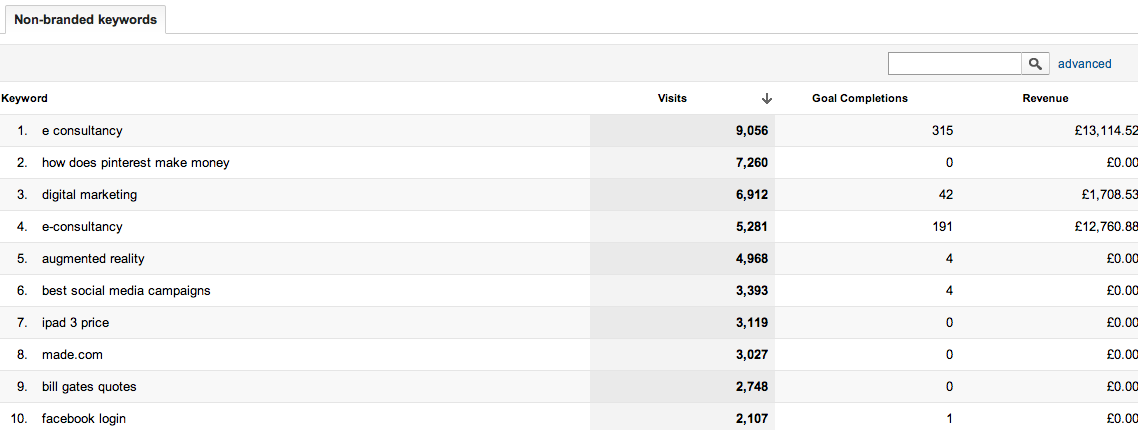

کدام کلمات کلیدی هستند که به بازدیدکننده به سوی مطلب شما می فرستند؟ این گزارش وظیفۀ پالایش واژگان کلیدی و نمایش بازدیدکنندگان و همچنین پیش بینی مقدار ارتقای سایت شما را دارد. دیگر وظیفۀ آن قادر ساختن شما برای کنترل نظرات، هدایت ترافیک به سایت و همچنین اعمال محدودیت در موضوعات معمول است.

داشبورد سئو مجددا گزارشی از آنا لویس از بلاگ معروف کوزای که به شما معیارهای جستجوی سازمان یافته را نشان می دهد. این معیارها عبارتند از: کارایی کلمات کلیدی برند شده/نشده، صفحات تبلیغاتی ویژه و موارد دیگر. تعداد زیادی از این معیارها را در این تصویر به صورت کلی ببینید. داشبورد سئو را دانلود کنید.

موضوعات مرتبط: [ چهارشنبه 7 اسفند 1392 ] [ 13:00 ] [ طراح ایرانی ]

در کتاب راههای بی انتها برای بهینه سازی وبسایت، سئو و بازاریابی آنلاین، جان روگنرود، به شما نشان می دهد که چطور پایه های وبسایت خود را استحکام ببخشید و رتبه های بالا را در موتورهای جستجو به دست آورید. در نسخۀ خلاصه شده از این کتاب، نویسنده یک خط بیرونی برای یک استراتژی موفق در بهینه سازی وبسایت ها را ترسیم می کند.

هدف بهینه سازی موتورهای جستجو، ترغیب دائمی crawlerها برای مراجعۀ همیشگی به وبسایت شماست نه آنکه تنها سایت و صفحات مورد نظر را پیدا کنند اما خب؛ این هم بخشی از کار ربات ها یا Crawlerها می باشد که شما را در صورت لایق دانستن به صفحات بالاتر در صفحات نتایج جستجو ببرند.

موضوعات مرتبط: [ چهارشنبه 30 بهمن 1392 ] [ 14:01 ] [ طراح ایرانی ]

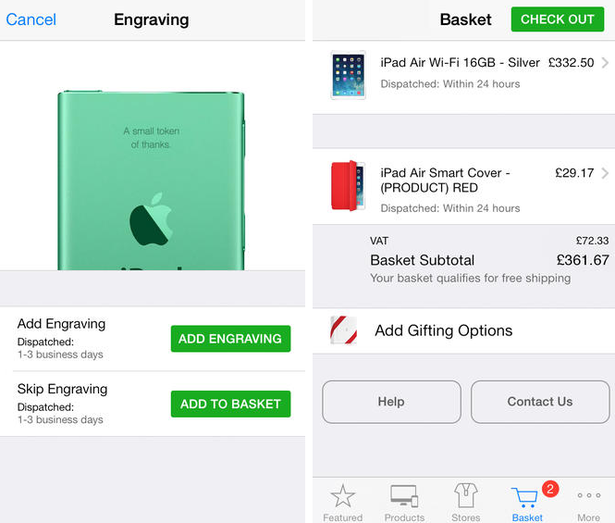

تیتر این مطلب از پایه درست است. این وبسایتها واکنشگرا نیستند. اینکه باید بشوند یا خیر مطلب دیگری است که باید در مناظرات مطرح کرد. شما هم نظر خودتان را در ارتباط با این موضوع مطرح کنید. نظر شما در مورد لیستی که در ادامه می آید چیست؟ کمپانی بزرگ اپل (Apple) از همین ابتدا تعجب نکنید چراکه سایتهایی هم رده و بزرگتر از اپل هم هستند که طراحیشان واکنشگرا نیست. اپل یک سایت واکنشگرا و یا حتا یک موبایل سایت ندارد. می پرسید پس چه دارد؟ البته، اپل از یک اپلیکیشن استفاده می کند.

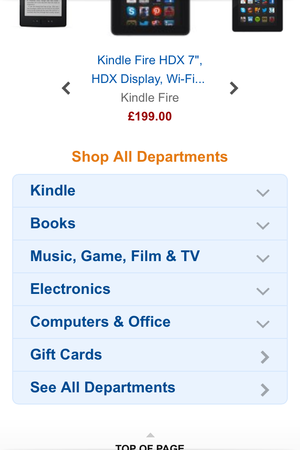

آمازون (Amazon)

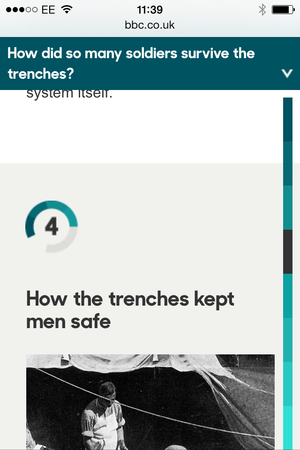

سرویس جهانی بی بی سی (BBC)

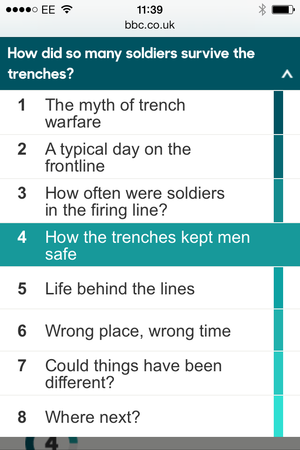

هافینگتن پست (Huffington Post) والمارت آمریکا (Wallmart USA)

تصویری از طراحی واکنشگرای والمارت کانادا:

بخش خبری سایت یاهو (Yahoo News)

تارنمای علی بابا (Alibaba)

سرویس اشتراک گذاری ویدیوی یوتیوب (Youtube)

موضوعات مرتبط: [ چهارشنبه 30 بهمن 1392 ] [ 14:00 ] [ طراح ایرانی ]

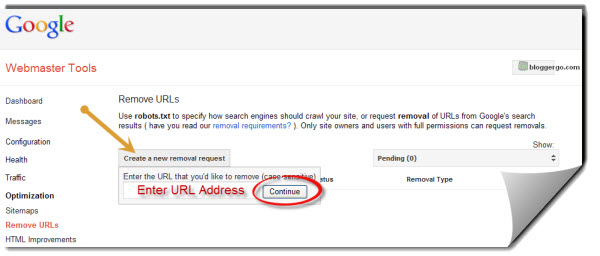

در مقاله وبمستر تولز به زبان ساده به طور کلی در ارتباط با بخش های مختلف وبمستر تولز توضیحاتی ارائه نمودیم. بخش Removal URLs

این ابزار را در بخش گوگل ایندکس در وبمستر تولز قرار داده اند. به این علت که یکی از پایه های اساسی سئو، حذف است. بله! همیشه تولید محتوای صرف، نمی تواند برای شما اعتبار بیاورد. گاها شما به حذف برخی از لینک های وبسایتتان نیز نیاز دارید. لازم است تا گرد و غبار کنید و کمی وبسایتتان را از کهنگی و اضافه باری که تنها ضرر دارند، در بیاورید. Removal URLs برای همین آمده است. این ابزار برای آن ساخته شده که شما بتوانید وب خود را از ایندکس هر نوع صفحه ای که خطاهایی نظیر 404، 503 و... دارد را معاف کرده و حتا نتایج پیشین را از گوگل حذف نمایید.

موضوعات مرتبط: [ يکشنبه 27 بهمن 1392 ] [ 13:48 ] [ طراح ایرانی ]

امروزه دیگر اگرچه متخصصین حرفه ای سئو و بهینه سازی وبسایت همچنان فعال هستند اما به صورت مشخص چند ده فاکتور برای عیب یابی و پیشنهادات متفاوت به صورت ابزاری آنلاین وجود دارند که تقریبا ما را به صورت اتوماتیک هدایت، راهنمایی و از نیازمندی به متخصصینی صرفا سئوکار احتیاجی نیست چراکه ماشین ها این کارها را به خوبی انجام می دهند.

موضوعات مرتبط: [ يکشنبه 27 بهمن 1392 ] [ 13:48 ] [ طراح ایرانی ]

همانطور که در مقاله ی کدام را انتخاب کنیم: سئو یا بهینه سازی؟ گفته شد اولین اصل سئو تولید محتوای جدید و غیرتکراری است اما با وجود این اصل مطالب کپی زیادی در وب دیده می شود و همچنین روش های زیادی برای کپی مطالب از جمله استفاده از Feed و کپی مطالب به صورت مستقیم وجود دارد.

خبرخوان و یا فید روشی ساده است که به شما این امکان را می دهد که به راحتی آخرین مطالب، اخبار ،عکس و یا هر اطلاعات دیگر را دریافت کنید و با استفاده از نرم افزار خبرخوان می توانید به راحتی آخرین مطالب سایت ها را ببینید.استفاده از هر دو روش کپی برداری مستقیم و خبرخوان می تواند موجب از دست دادن بخشی از کاربران سایت شما شود.

موضوعات مرتبط: [ يکشنبه 27 بهمن 1392 ] [ 13:47 ] [ طراح ایرانی ]

شبکه های اجتماعی جدیدترین ابزار در بازاریابی اینترنتی هستند که به طور قابل توجهی باعث رشد سریع وبسایت ها می گردند. استفاده از این شبکه ها روز به روز در حال افزایش هستند و موفقیت و اعتبار شرکتها در استفاده از این سبک جدید تبلیغات به صورت بالقوه در حال رشد است.

اگر بخواهیم در یک جمله، سخن را خلاصه کنیم، می توانیم بگوییم که شبکه های اجتماعی، یک انقلاب هستند. چه وبسایت داشته باشید و چه نداشته باشید.

موضوعات مرتبط: [ يکشنبه 27 بهمن 1392 ] [ 13:47 ] [ طراح ایرانی ]

تصور می کنیم که شما 2 سایت طراحی کرده اید و هرکدام در دو زمینۀ متفاوت و مختص به خود مشغول به فعالیت هستند. یکی از این سایتها را 2 سال پیش طراحی نموده اید و در جریان این 2 سال فعال بوده است. و دیگری را حدود 1 ماه است که اجرا نموده و هر روز مطالبی تخصصی در آن درج می کنید. هیچ کدام از این 2 سایت سئو نشده اند. حال قصد دارید سایت شمارۀ 3 را در یکی از همان دو زمینۀ تخصصی راه اندازی کنید. اکنون این پرسش مطرح می شود: آیا باید سایت قدیمی را بهینه سازی و سئو کنید و یا از نو سایتی دیگر طراحی کنید و از همان ابتدا آن را سئو، بهینه سازی و اصولی نمایید؟ این پرسش مدت هاست در ذهن مدیران وبسایت هاست. ما در مثال بالا بهترین حالت ممکن را آوردیم. حالتی که سایت پیشین هم فعال بوده و تنها سئوی خاصی بر روی آن انجام نگرفته است. اکنون فرض کنید که سایت قدیمی با قدمت 2 ساله نه تنها سئوی مناسبی نداشته که محتوای تکراری و کپی درج نموده، دورۀ زمانی مشخصی برای به روزرسانی انجام نداده، و همچنین از ابزار وبمستر تولز نیز کوچکترین بهره ای نبرده تا آنالیزی هرچند کلی از تارنمای مربوطه داشته باشد.

در ارتباط با مدل شمارۀ 1، پاسخ مورد نظر متفاوت با مدل شمارۀ 2 می باشد. از همین مثال دوم آغاز می کنیم: پاسخ کوتاه این است که سئوی تارنمای مذکور با توجه به عدم استفادۀ وبمستر آن از ابزار وبمستر تولز گوگل، اگر ناممکن نباشد به شدت غیر قابل پذیرش است که بتواند توجه ربات ها و صفحات نتایج جستجوی گوگل را به خود معطوف کند (آن هم با این ارفاق که از کنار لینک های جریمه شده بگذریم!). اما نشدنی هم نیست. این نشدنی نبودن به راحتی طراحی یک سایت جدید نیست و بسیار سخت خواهد بود. از موارد ساده ای که می توان به آن اشاره کرد، ثبت سایت در موتورهای جستجو، ثبت در وبمستر تولز گوگل و آنالیز کامل آن پس از حدود 1 ماه، تولید محتوای جدید، رفع خطاهای واکنش دستی و غیره! برای مشاوره و راهنمایی با کارشناسان ما تماس بگیرید! و اما مورد یکم که مرتبط با سایتی است که 2 سال فعالیت مداوم داشته، تولید محتوا نموده اما بر اساس اصول سئو حرکت نکرده است هرچند که اولین اصل سئو تولید محتوای جدید و غیر تکراری است. چنین سایتی با صرف زمان قابل توجهی به آسانی و البته با استفاده از متخصصین مجرب، امکان ارتقای پلکانی و حتا آنی را داشته و در جایگاه حقیقی خود در صفحات نتایج جستجوی گوگل قرار خواهد گرفت. خواه رتبۀ یکم و خواه رتبه دهم! از روش های موثر و آغازین سئوی یک سایت، ثبت آن در وبمستر گوگل، ارسال ربات های گوگل یا Crawlerها جهت بررسی تک تک لینک های تارنمای مورد نظر، کشف و اصلاح خطاهای سرور اعم از 404، 503 و امثالهم، یافتن Manual Actionها، ساختن بک لینک داخلی و ارسال و دریافت بک لینک حقیقی خارجی و مواردی از این دست می باشند.

توجه داشته باشید که سئو تنها محدود و منحصر به ایجاد چند لینک داخلی، یافتن و حذف و اصلاح نمودن لینک های تخریب شده و غیر قابل استفاده نیست. سئو شدن یک وبسایت نیازمند فردی متخصص در همین زمینه می باشد که به جای اصلاح، سایت را به اعماق جریمه ها و نابودی کامل آن نکشاند. بارها در سایر مقالات و کتب سئوی زیاد و عدم سپردن بهینه سازی سایت به دست افراد نابلد، طرح شده است. همانطور که برای هر آچاری که بر ماشین تان می کشید ارزش قائلید و نگران هستید، همان را به سطح سایت خود ارتقا داده و جلوی تخریب آن را نه تنها گرفته که به بهترین وجه ممکن کار رو تمام خواهیم نمود. توجه بفرمایید که در بسیاری از سرویس های وب نویسی، عدم ایجاد تغییرات در برخی از این سرویس ها به صورت هشدارگونه در ارتباط با فایلهایی چون robots.txt مطرح گشته است. در ارتباط با robots.txt بیشتر بخوانید.

موضوعات مرتبط: [ 22 بهمن 1392 ] [ 17:12 ] [ طراح ایرانی ]

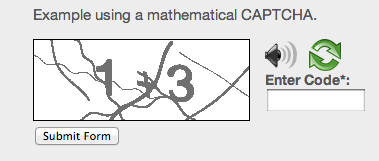

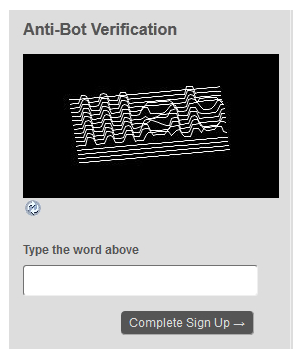

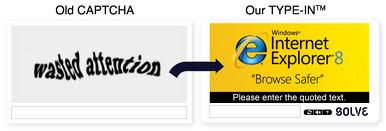

حتما تا بحال هنگام فعالیت های اینترنتی مانند تبادلات مالی آنلاین ، ترافیک وب سایت ها و موتورهای جستجو ، نظرسنجی های آنلاین ، ثبت نام های آنلاین ، سرویس های ایمیل رایگان و بسیاری دیگر از چنین موارد با کادری روبرو شده اید که حاوی اعداد و یا حروف به صورت نامرتب و کج است Captcha نرم افزاری ست که با پرسیدن سوالاتی که جواب دادن به آنها توسط انسان راحت است می پردازد و به منظور حمله به این سیستم ها طراحی شده اند.Captcha در واقع یک مکانیزم امنیتی محسوب می شود که تعیین می کند که طرف مقابل شما یک کامپیوتر است یا یک انسان .لازم به ذکر است بدانیم که تست تورینگ توسط انسان برگزار می شود و هدفش تشخیص ماشین است اما کپچا توسط ماشین برگزار می شود و هدفش تضخیص انسان است. √ Captcha تصویری همراه با صدای تلفظ شده کاراکتر درون عکس √ Captcha ای که باید عکس موردنظر را در تصویر پیدا کرد

√ Captcha ای که باید که مسدله ی ریاضی ساده حل کرد

√ Captcha های سه بعدی

√ Captcha هایی با استفاده از تبلیغات

با استفاده از کپچا تنها انسان ها قادر به انتشار نظر در بخش وبلاگ سایت شما خواهند بود و به این ترتیب نیاز به عضویت در سایت یا وبلاگ شما برای جلوگیری از نظرات اسپم نیست.

موضوعات مرتبط: [ 21 بهمن 1392 ] [ 17:12 ] [ طراح ایرانی ]

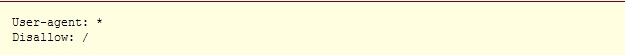

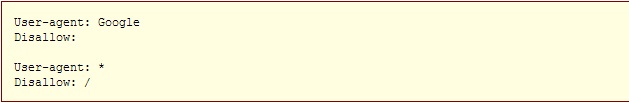

ربات های وب (که به نام های سرگردانان وب، خزندگان یا عنکبوت ها نیز شناخته می شوند) به برنامه هایی می گویند که به صورت خودکار سراسر وب را می گردند و جستجو می کنند. موتورهای جستجویی نظیر گوگل از آنها برای محتوای درون وب استفاده می کنند و اسپمرها برای به دست آوردن ایمیل آدرس ها. آنها کارایی های بی شماری دارد. توضیحات واضح در مورد فایل robots.txt دارندگان سایت ها از robots.txt جهت معرفی ساختار سایتشان به ربات های سراسر وب استفاده می کنند. یک مثال در ارتباط با چگونگی کارکرد این فایل: یک ربات جستجوگر مثل ربات گوگل قصد ورود به سایت شما را دارد تا موارد مورد نظرش چون خطاها، صفحات، محتوا، تصاویر و غیره را ایندکس کند. در صورتی که صفحه ورودی شما http://www.example.com/welcome.html باشد، ربات مورد نظر ابتدا و پیش از هر نوع بررسی سایت شما نشانی http://www.example.com/robots.txt را چک خواهد کرد. و در نهایت به این دستورات بر خواهد خورد:

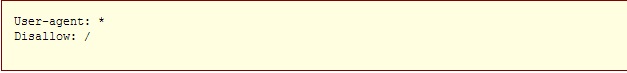

عبارت User-agent: * به معنای این است که این سایت و این دستور برای همۀ ربات ها یکسان است. و قسمت Disallow: / حاوی این پیام است که هیچ رباتی نباید هیچ قسمتی از این سایت را بررسی و مشاهده نماید. دو نوع نگرش نسبت به استفاده کنندگان از robots.txt وجود دارد: 1. ربات ها می توانند robots.txt شما را نادیده بگیرند! به خصوص آنکه ربات های مخرب، کارشان اسکن نمودن سراسر وب برای یافتن نقص های امنیتی، ایمیل آدرس ها و غیره است، کوچکترین توجهی به محتویات robots.txt ندارند. 2. فایل robots.txt یک فایل در دسترس عموم می باشد. هرکسی می تواند ببیند که شما کدام قسمت را تمایل ندارید که ربات های دیگر ببینند. *پس برای مخفی نمودن اطلاعاتتان با استفاده از robots.txt تلاش نکنید. نحوۀ ساخت یک فایل robots.txt کجا آن را قرار دهیم؟ پاسخ کوتاه: در بالاترین سطح دایرکتوری سرور سایتتان پاسخ کامل: زمانیکه یک روبات به دنبال فایل robots.txt برای نشانی URL شما می گردد، به دنبال اولین اسلش پس از اکستنشن شما می رود و به صورت اتوماتیک عبارت robots.txt را قرار می دهد. برای مثال اگر داشته باشیم: http://www.example.com/shop/index.html، ربات مورد نظر /shop/index.html را حذف نموده و /robots.txt را جایگزین و در انتهای URL قرار می دهد. به همین خاطر شما به عنوان دارنده سایت می بایست این فایل را در مکان صحیح و جایی قرار دهید که در نتایج جستجو دیده شده و عمل نماید. معمولا این فایل را در جایی مشابه همان صفحه اصلی سایت (index.html) یا همان صفحۀ به اصطلاح خوشامدگویی قرار می دهند. *فراموش نکنید که تمام حروف این فایل کوچک نوشته می شوند: صحیح: robots.txt ؛ غلط: Robots.TXT چه چیزی در آن بنویسیم؟ فایل robots.txt یک فایل متنی است که از یک یا تعداد بیشتری از دستورات ساخته شده است. به صورت معمول شامل یک دستور شبیه به این می شود:

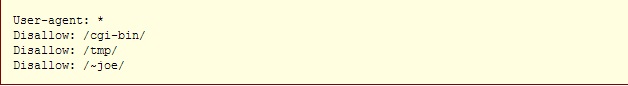

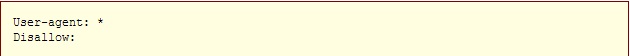

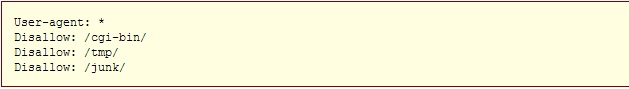

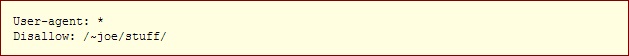

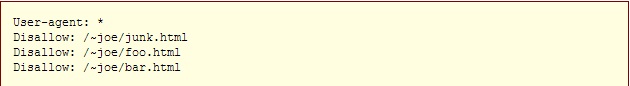

در مثال فوق شاهد 3 دایرکتوری محروم شده هستید که با استفاده از این 3 دستور، پیامی به ربات های سراسر وب ارسال می کند که به معنی عدم دسترسی ایشان به فایل های مشخص شده است. توجه داشته باشید که برای محروم نمودن ربات ها به یک URL خاص، باید در هر خط مجزا یک دستور جدید را وارد نمایید. شما نمی توانید دستور Disallow: /cgi-bin/ /tmp/ را در یک خط وارد نمایید. همچنین نباید در مقابل یک دستور، خط را خالی بگذارید چراکه برای ربات این تصور می شود که دستور مورد نظر برای تمام وبسایت شما قابل اجرا است. ضمنا شما نمی توانید به صورت منظم و نامنظم دستورات داخل فایل را با یکدیگر ادغام نمایید. برای مثال علامت "*" در فیلد User-agent به معنای آن است که دستورات وارد شده در مقابل این عبارت برای تمامی ربات ها لازم الاجراست. به طور مشخص و عینی شما نمی توانید دستوراتی چون User-agent: *bot*", "Disallow: /tmp/*" or "Disallow: *.gif را در کنار همدیگر وارد نمایید. بررسی دقیق نمایید که چه چیزهایی را نمی خواهید ربات ها ببینند. هرچیزی را که نمی خواهید آنها ببینند را به راحتی می توانید از دیدشان مخفی کنید. به مثال های زیر توجه بفرمایید: خط فرمان به تمام ربات ها برای عدم دسترسی به کل سایت شما خط فرمان به تمام ربات ها برای دسترسی به کل سایت شما برای اجرای دستور فوق همچنین می توانید یک فایل robots.txt بدون متن بسازید و هیچوقت به سراغش نروید. خط فرمان به تمام ربات ها برای عدم دسترسی به بخشی از سایت شما

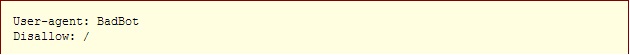

خط فرمان به یک ربات خاص برای عدم دسترسی اش به کل سایت (برای مثال نام ربات "BadBot" است) خط فرمان به تنها یک ربات خاص جهت دسترسی به کل سایت شما و عدم دسترسی سایر ربات ها: خط فرمان به تمام ربات ها برای عدم دسترسی به تمام فایل ها به جز برخی از آنها: یا برای مشخص نمودن دقیق یک نشانی و یا فایل می توانید از این دستورات استفاده کنید و نشانی دقیق را در باکس robots.txt وارد نمایید.

موضوعات مرتبط: [ 20 بهمن 1392 ] [ 17:12 ] [ طراح ایرانی ]

|

||